GPTinfのAIヒューマナイザーに代わる、本当に効果的な無料の代替ツールを探しています。自分が生成したコンテンツが、さまざまな検出ツールでAIによる文章だと判定されてしまい、GPTinfの無料プランは制限が多いか、結果が安定していません。文章の読みやすさを損なわずに、一般的なAI検出ツールを通過しやすくしてくれる、信頼できる無料ツールやワークフローがあれば教えてもらえませんか。

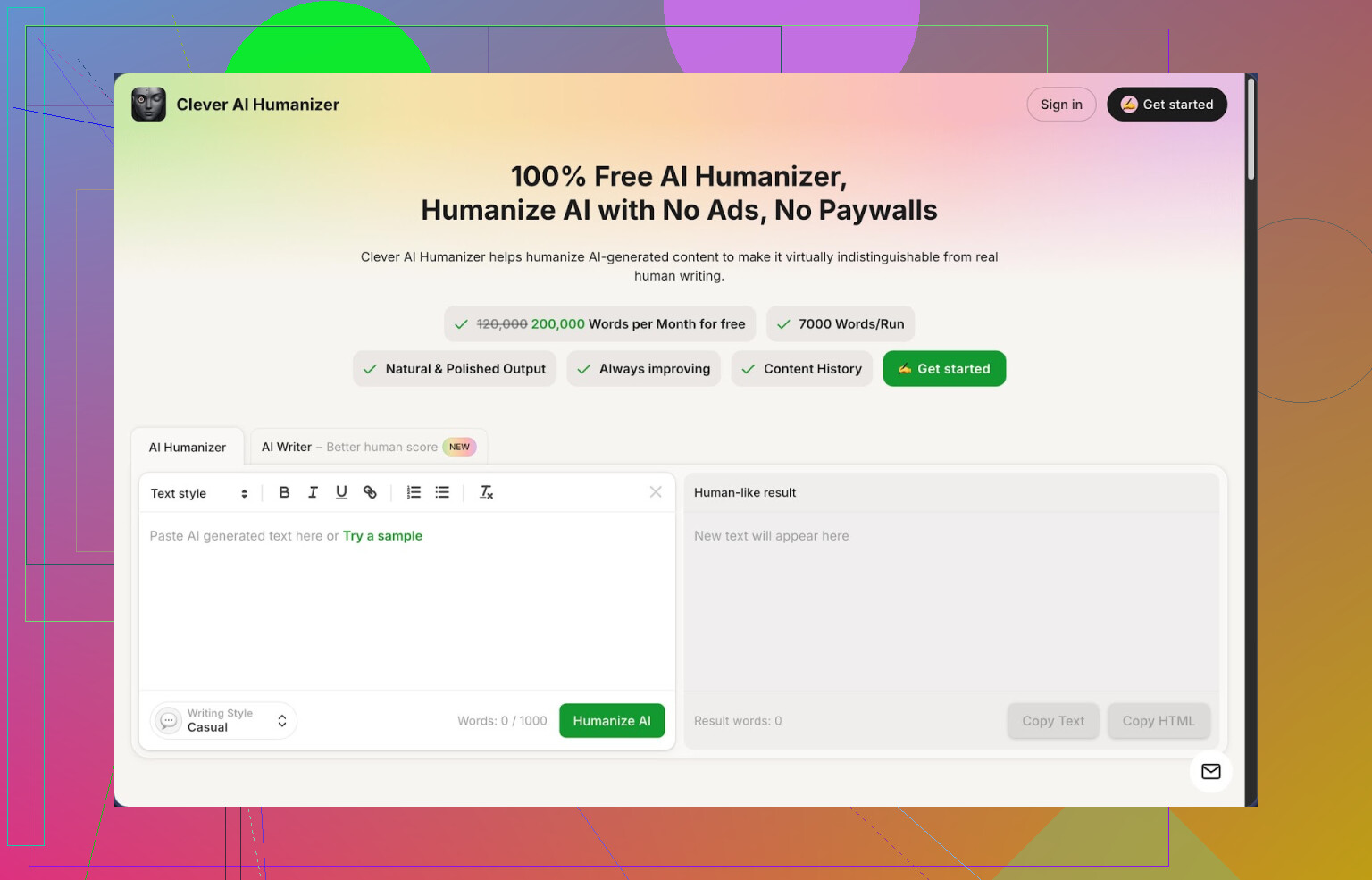

1. Clever AI Humanizer レビュー

Clever AI Humanizer は、無料の AI ヒューマナイザーを探している人に聞かれたとき、3プロンプトで使い物にならなくなるようなツールではないものとして、結局いつも勧めるサービスです。

かなりハードに使い込んで数日試したあとの印象はこんな感じです。

- 無料プランで毎月およそ 200,000 ワードまで利用可能

- 1 回の実行で最大 7,000 ワードまで対応

- 出力スタイルは「カジュアル」「やさしいアカデミック」「やさしいフォーマル」の 3 種類

- AI ライターを内蔵しており、執筆と人間らしさの調整を同じ画面で完結できる

ZeroGPT でカジュアルスタイルを使ってテストしたところ、3 本のサンプルはいずれも「AI 0%」判定でした。どの検出器も最終的な判断として完全に信用しているわけではありませんが、先生や上司、クライアントがそうしたツールにこだわっているなら、かなり役立ちます。

自分は日常的に AI で文章を書いていますが、パターンはいつも同じです。文章がぎこちなくなり、検出器には「100% AI」と叫ばれ、手作業で直しすぎると 1,000 ワードの下書きに 1 時間かかってしまう。だからこそ、今年またヒューマナイザーを探し直し、このツールには想像以上に長く落ち着くことになりました。

ここからは、メイン機能が実際どう動くかを説明します。

AI が書いた文章を貼り付けてスタイルを選び(自分はブログならカジュアル、レポートならやさしいアカデミックを使うことが多いです)、ボタンを押すと数秒で新しいバージョンが生成されます。出力では、典型的な AI 文のリズムを崩し、少しだけ「粗さ」を足しつつ、構成は大きく変えないようにしてくれます。クライアント向けの記事で元の文と出力を横並びで比較しましたが、意味はぶれず、変な事実や存在しない出典が紛れ込むこともありませんでした。

ワード数の上限が大きいのも重要です。ChatGPT や Claude が出した 5,000 ワードくらいの文書を、一気にまとめてかけられるので、小さい塊に分割しながらトーンの一貫性を祈る必要がありません。月 20 万ワードあるおかげで、トークンを細かく気にしなくなり、ワークフローから一つ悩みが消えました。

あとで編集していて気づいたのは、このツールは書き手の意図を壊さないという点です。表現を少しずつずらし、文の形を変え、細かい部分の順番を入れ替えますが、主張をひっくり返したり、論旨を別物に書き換えたりはしません。表現がシビアに決まっているエッセイの場合は今でも一通り目を通しますが、段落単位で丸ごと戻す必要はほとんどありませんでした。

メインのヒューマナイザー以外にも、別タブで開いていたツールを 1 ページにまとめる目的で試したところ、意外と使える追加モジュールがいくつかありました。

Free AI Writer は、まだ下書きがないとき用です。トピックと短いプロンプト、あるいはざっくりしたアウトラインを渡すと、エッセイやブログ記事、記事本文を生成してくれます。そこから同じテキストを、そのまま UI 内でヒューマナイザーに回せます。この組み合わせを試したところ、ZeroGPT や GPTZero などの検出ツールでの人間スコアは、汎用的な ChatGPT 出力をコピペしてあとから人間味を足す場合より良いことが多く、おそらく最初の生成段階からこの用途向けに調整されているためだと思われます。

Free Grammar Checker はオーソドックスな文法チェックです。テキストを貼り付けると、自動でスペル、コンマ、主語と述語の一致、いくつかの言い回しの問題を修正してくれます。いくつかの文章をこれと Grammarly 両方にかけて比べましたが、ニュアンスや文体の指摘は Grammarly の方がまだ上でした。ただ、クライアントに送る前やオンラインへ投稿する前の軽い仕上げなら、ほとんどの場合これで十分でした。

Free AI Paraphraser Tool は、想像以上に時間を使った機能です。古い下書きやクライアントのブリーフ、商品説明など、事実はそのままにトーンだけ変えたいときに使います。SEO 対策や古い記事の刷新でも、スピンテキストのような不自然さが出ない別バージョンを作るのに役立ちました。2,500 ワードの購入ガイドで試したときも、構成はそのままで表現だけ十分に変わり、盗用チェックでも問題は出ませんでした。

まとめると、1 つの UI の中にヒューマナイザー、ライター、文法チェッカー、パラフレーズツールの 4 つが入っている形です。自分が落ち着いたワークフローはこんな感じです。

- ChatGPT か内蔵 AI Writer で下書きを作る

- 全文をヒューマナイザーにかけ、カジュアルかやさしいアカデミックを選ぶ

- 出力をざっと確認し、変な言い回しは Grammar Checker で整える

- クライアントが別トーンのバージョンを求める部分だけ Paraphraser で作り直す

この流れにしてから、ワード上限やトークン制限がバラバラな複数サイトを行き来する時間がかなり減りました。

完璧かといえば、そうではありません。

一部の検出ツールでは、いまだにテキストの一部が AI と判定されます。たとえば GPTZero は、ヒューマナイズ後でも長いアカデミック寄りの段落を部分的に AI とマークすることがありました。学校や会社のルールが厳しい場合は、自分の手で編集を混ぜたり、セクションの順序を変えたり、個人的なエピソードを加えたりして、より安全側に倒す必要があります。

また、文字数が増えがちという癖もあります。書き換えの際に、文を短くするより、長く膨らませることが多いのです。1,500 ワードの ChatGPT 記事が、ヒューマナイズ後には 1,900 ワード前後になることが何度もありました。厳格なワード上限がある場合は、最後に自分で削る作業が必要になります。

それでも、この記事を書いている時点でまだ完全無料で使えるツールとしては、「サブスクを払いたくないけれどヒューマナイザーは欲しい」という人にまず勧めているサービスです。

スクリーンショットや AI 検出結果をもっと詳しく見たい場合は、こちらの詳細レビューが参考になります。 https://cleverhumanizer.ai/jp/community/t/clever-ai-humanizer-review-with-ai-detection-proof/42

動画でのウォークスルーもあり、実際のテストをステップごとに確認できます。

Clever AI Humanizer Youtube レビュー https://www.youtube.com/watch?v=G0ivTfXt_-Y

ほかのユーザーの声やツールの比較を見たい場合は、次の Reddit スレッドが役に立ちました。

Reddit でおすすめされている AI ヒューマナイザーまとめ https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=ja

AI テキストの人間らしさ調整についての総合スレッド https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai?tl=ja/

短くいうと、ワンクリックで「完全に検出されない」魔法のボタンはないけれど、ツールを組み合わせて自分で手直しすれば、無料でもかなり近づける。

自分にとってうまくいったやり方をいくつか挙げる:

- Clever Ai Humanizer

@mikeappsreviewer の意見にはかなり同意だけど、自分は「任せっぱなし」で使わない。

自分が違う点:

• 一度に扱うのは 5,000語全部ではなく、800~1,200語くらいの短いセクション。そうした方が自然な文になりやすい。

• 最初と最後の2~3文は必ず自分の手で直す。検出ツールは定型的な書き出しと締めを好んで拾う。

• 最終用途がレポートや課題でも、完全な「アカデミック調」にはしない。カジュアルかシンプルフォーマルを混ぜて、その上に自分の専門用語を足す。

こうすると ZeroGPT や GPTZero では「ほぼ人間」と出ることが多い。完璧ではないが、自動フラグが即座に立つのは防げる程度にはなる。

- 無料ツールを使ったマルチパス書き換え法

ひとつの人間化ツールに頼りたくないなら、この組み合わせが使える:

ステップ1: どのLLMでもいいのでまず生成する(短く区切る)。

300~500語くらいのブロックで書く。長くて単調なセクションは検出されやすい。

ステップ2: チャンクごとに言い換える。

Clever Ai Humanizer のパラフレーズ機能か、他の無料パラフレーズツールを使う。表現だけ変えて内容は維持。

ポイント: 文書全体を一気にパラフレーズしないこと。同じリズムの繰り返しは検出されやすい。

ステップ3: 自分なりの「ノイズ」を足す。

今のLLMがあまりやらない要素を手作業で入れる:

• 所々に短い未完結文。

• 目立つ誤字は1~2個直しつつ、あえてごく軽い誤字か少し変な言い回しを1つ残す。

• 具体的な参照: 自分の住んでいる街名、先生が出した課題の文言、自分の過去の課題や授業で出た例など。

ステップ4: 文の長さにばらつきをつける。

どれか一段落を選んで、あえて変化をつける:

• 5~8語くらいの短文を1つ。

• 25~30語くらいの長めの文を1つ。

• その後に15語前後の普通の文。

人間の文章はこういうバラつきが多いが、AIの出力は狭いレンジに収まりがち。

-

構造レベルの編集(検出ツールが嫌う部分)

多くの人は単語だけを変えるが、検出ツールは構造も見ている。次を試す:

• 中盤の段落を2つ入れ替える。

• 短い段落を2つまとめて1つにする。

• はっきりした自分の意見や立場を述べる短い段落を1つ追加する。

• 見出しを、ありふれた表現ではないものに変える。 -

何を過信すべきでないか

単一の検出ツールのスクリーンショットを「証拠」として重視しすぎる点には少し反対。

自分のテストでは:

• 同じ文章でも、ZeroGPT では人間扱いなのに、Originality では80~90パーセントAI判定になったことがある。

• 手動修正と Clever Ai Humanizer を通した後は、ZeroGPT、GPTZero、Originality の3つとも「混在」か「おそらく人間」に近づいた。

先生や上司が無料の検出ツールを1つだけ使っているなら、実際にはそれ1つで良く見えれば足りる。クライアント案件や公開ブログでは、複数ツールで「混在」くらいになったところで深追いをやめて先に進むようにしている。

- そのままマネできる実用ワークフロー

お金をかけずに回せる最低限の流れは次の通り:

- どのLLMでもいいので、小さいセクションごとに書く。

- 各セクションを Clever Ai Humanizer に通し、トーンはカジュアルかシンプルフォーマルにする。

- それでも不自然な段落を1~2個選び、別の無料パラフレーズツールでもう一度言い換える。

- 手作業で:

• 文の長さに変化をつける。

• 小さな個人的ディテールを1~2個挿入する。

• 一部の誤りは直しつつ、文章は少しだけ不完全なまま残す。 - 最後に、先生やクライアントが使っているのと同じ検出ツールに全文をかけて、一番強くフラグが立っている箇所だけを重点的に直す。

最後に。これが学校向けで規則が厳しいなら、自分自身の思考をちゃんと足すことが最大の防御になる。自分の例、自分なりのミス、自分が読んだ資料の参照を入れる。どんなツールもそこは代わりにならない。人間化ツールは手助けにはなるが、最後の一押しをしてくれるのは自分の編集だ。

もしあなたの目標が「二度とフラグされないこと」なら、それはユニコーンを追いかけているようなものです。検出器は確率的に推測する機械であって、嘘発見器ではありません。とはいえ、GPTinfに課金しなくても、検出される率をかなり下げることはできます。

@mikeappsreviewer と @jeff がすでに Clever Ai Humanizer 本体やマルチパスのテクニックを解説してくれているので、ここでは彼らのアプローチと実際に「違う」点だけを補足します。

1. 多くの人とは逆方向に Clever Ai Humanizer を使う

みんながやりがちな流れはこうです。

LLM → 長文ドラフト → humanizer → 祈る → 検出器

自分が試してみてうまくいったパターンは次の通りです。

- 手でアウトラインを書く(見出し+各セクション2〜3個の箇条書き)。

- 各セクションごとに、まず自分でざっくり短い段落を書く。出来が悪くても気にしない。

- それを Clever Ai Humanizer に入れて、「全部書き直す」のではなく「改善して」と指示する。

こうすると、構成も変な言い回しもあなたのもののままで、必要最低限の整えだけが入ります。検出器は「文言」そのもの以上に、「完全に機械が組んだっぽい構成」を嫌っているように見えます。

2. 毎回ぜんぶ書き直さなくていい

「全部のセクションをツールに通すべき」という考え方には、少し反対です。

代わりにこうしてみてください。

- まずLLMで生成する。

- そのうち、いかにもAIっぽい段落だけを Clever Ai Humanizer にかける(ありきたりなブログ量産文や教科書の序章みたいな部分)。

- 原稿の20〜30%は、完全に自分の文章のまま残す:小さな愚痴、自分の体験談、ちょっとした横道のコメントなど。

検出器は「一貫性」にかなり依存しています。1,500文字以上でトーンが完璧に揃っていると逆に怪しい。少し荒い・雑なセクションが混ざっているくらいが自然です。

3. 文体だけでなく「情報密度」を変える

検出器はトーンだけを見ているわけではなく、情報や論理展開の「詰まり具合」も見ています。

Clever Ai Humanizer などのツールは便利ですが、こういう使い方をすると有効です。

- あまり重要ではないがもっともらしい寄り道を1〜2個足す。

- つなぎの文を少し削って、流れをわざと少しギクシャクさせる。

- 論理をきれいに並べ過ぎない。人間の議論は少し脱線するほうが自然です。

例えば:

「まずXであり、次にYであり、最後にZである。」

ではなく、

「まずXがあります。それとは逆にAみたいなケースもたまに見ます。そのあとYですね。Zは状況によっては省いてもいい部分です。」

のような感じです。

これを促すために、貼り付ける前に短く指示をつけてもいいでしょう。

「教科書っぽくなりすぎないように、少し寄り道の多い話し方にしてください。小さな脱線は残してください。」

4. すべての検出器でAI率0%を狙うのをやめる

あまり人気のない意見ですが、「どれか1〜2個の主要ツールで“混合”か“人間っぽい”と出れば十分なことが多い」です。自分のケースではこんな感じもありました。

- ある検出器でAI判定10〜20%

- 別の検出器で人間70%

- 三つ目では「判定不能」

共通の標準なんて存在しません。ZeroGPT, GPTZero, Originality などでAI率0%を狙い続けるのは、時間だけ溶かして結局報われないパターンです。

現実的な目標としては:

- いかにも硬い部分だけ Clever Ai Humanizer で1回通す。

- @jeff が書いていたような軽い手作業の修正をする。

- 先生やクライアント、使うプラットフォームが指定している「その検出器だけ」にかける。ネット上のありとあらゆるツール全部には通さない。

5. Clever Ai Humanizer を「ノイズ発生器」として使う

もう少し攻めた使い方もできます。

- テキストを入れて「少しトーンが不揃いになるように」「カジュアルとセミフォーマルを混ぜて」といった指示を意図的に出す。

- 「あまり上手くない言い回しを1〜2個そのまま残して、仕上がりを完璧にしすぎないで」などと頼む。

そのうえで、出てきた粗さを全部校正ツールで磨き上げないでください。人間の文章は多少ガタガタしているものです。2,000文字全部が完璧な文法になっているほうが、多少のタイプミスがある文章よりもずっとLLMっぽく見えます。

6. 学校向けならリスク対策をしておく

Clever Ai Humanizer や GPTinf であっても、「AIの関与を一切禁止」しているポリシーからは守ってくれません。学校や職場が厳しい場合は:

- メモを見ずに、自分の主張を口頭で説明できるようにしておく。

- 手書きや荒い初期ドラフトを残しておき、「自分が作業した証拠」にする。

- 例やケーススタディを最低1つは、「自分のクラス」「自分の職場」「自分の住んでいる街」で実際にあったことに変える。

どれだけ優秀な「AI humanizer」でも、誰かが本気で調査してきたときの盾にはなりません。あくまで作業を楽にする補助だと思ったほうが安全です。

まとめると:

Clever Ai Humanizer は、特にGPTinfの制限にうんざりしているなら「ちゃんと効く数少ない無料ツール」の一つではあります。ただし、これを魔法の「透明マント」みたいに扱うのはやめてください。自分の構成と自分の中身と混ぜて使い、「どの検出器でもAI率0%」を狙うのをやめない限り、学ぶことや書くことよりもスキャナーと戦うことに時間を使う羽目になります。

短く言うと 完璧な「AI → 人間」ボタンは存在しないが どの人間化ツールを使うかだけでなく その使い方を変えることで 検出されにくい文章を安定して作ることはできる

@jeff や @mikeappsreviewer がすでに触れている(分割処理 文のバリエーション 構成の微調整)点や @stellacadente の複数ツール併用の話は省き 彼らがあまり踏み込んでいない角度に絞って説明する

1. 文単位ではなく 「トピック単位のノイズ」を入れる

多くの人は言い回しだけをいじるが 検出ツールが見ているのはそれだけではない

- 議論の流れがどれくらい「レールの上」を走っているか

- 話題の切り替えがどれくらい滑らかすぎるか

- 内容のバランスが整いすぎていないか

かなり効くやり方は

- まず文章を生成するか 下書きを書く

- Clever Ai Humanizer を使う前に 自分で小さな「脱線だけど関連はある」ミニセクションを1~2個足す 例えば

- 手短な体験談

- 「自分にはうまくいかなかった例」の一言

- はっきり言い切れないと認める一段落

こうした「アイデアレベルの不完全さ」のほうが 単なる言い換えよりよほど人間らしく見える

そのうえで その周辺の段落だけを Clever Ai Humanizer に通し 文体をなじませつつ 自分のクセは残す

2. 人間化ツールだけでなく 「AIの出どころ」も分散させる

ここは「同じツール構成をずっと使う」派に少し反対の立場

いつも同じ LLM で生成し 同じ人間化ツールで整えると 指紋が読まれやすくなる 無料で回すなら

- アウトラインとラフ案はある LLM で作る

- 文章の10~20%だけを 別の無料 LLM にリライトさせる

- そのあと全体を Clever Ai Humanizer に通してトーンを均す

こうして複数の「声」を混ぜ 人間の手も入れると 同じモデルを3回かけ回すより検出されにくくなる

3. Clever Ai Humanizer の 実際に効く長所と短所

長所:

- 無料で扱える文字数がかなり多く 何度か試してもすぐには限界に当たらない

- 長文を突っ込んでも 構成が大きく壊れにくい

- Casual や Simple Academic など 文体の違いがはっきりしており 1つの文書内で混ぜても使える

- メインの人間化ツールというより 「仕上げ」に向いている

短所:

- 全体的に文字数が増えがちで 制限の厳しい課題では困ることがある

- 何もしないと 仕上がりが「きれいすぎる」ので あえて小さな欠点を手動で戻したほうがよい

- アカデミック寄りを強めすぎると 長い段落が 一部の検出ツールでまだ光ることがある

- 自分で内容を考えるのをやめてしまいがちで それこそ厳しい先生に疑われる原因になる

なので Clever Ai Humanizer が 無料ツールのなかでは検出スコアを下げやすいという @mikeappsreviewer の指摘には同意するが 文章の100%を任せるのはおすすめしない

4. 多くの人がやらない「ミクロなパターン崩し」

誰もが文の長さのバリエーションには触れるが 最近の検出ツールが特に見ているのは

- 「In conclusion」「Overall」「Additionally」など 汎用つなぎ言葉の多用 → それらは潰すか言い換える

- 「第一に… 第二に… 第三に…」のような 完璧な並列リスト → 崩すかパターンを途中で切る

- ひたすら中立で淡々としたトーン → 「正直これは面倒だ」「ここは今でも分かりにくい」など 感情をにじませる一文を数箇所入れる

これは Clever Ai Humanizer に通したあとで手動でやる 3~5分の仕上げで十分で

- 汎用的なつなぎ表現を最低2つは削除

- 数段落おきに 懐疑的・主観的な一文を足す

- コピーライターっぽくない 自分らしい少し不格好な表現をあえて1つ残す

この程度の追加と人間化ツールの併用で 「あきらかにAI」から 「混在/判定保留」レベルまで落ちることがよくある

5. 検出ツール(やレビュー担当)を1つだけ信用しない

他のコメントでも出ていたように

- @jeff は構造編集寄り

- @stellacadente はワークフロー設計寄り

- @mikeappsreviewer は Clever Ai Humanizer を使った長文人間化寄り

どれも状況によっては効く 同じ文章であっても

- ある検出ツールでは「人間らしい」

- 別の検出ツールでは「AIの特徴が強い」

という結果になったことが何度もある

だから「どこでもAI率0%」を追い回すより

- 実際に採点権や判断権を持っている人(先生 クライアント 上司 プラットフォーム)が どの検出ツールを使うかをまず確かめる

- そのツールに最適化しつつ 予備で1つだけ別ツールで確認する

- その2つで「混在」か「主に人間」と出たら そこでやめて先へ進む

6. 他の回答と被りにくい ハイブリッドな実践ワークフロー

他の手順と少し違う流れを試したいなら

- アウトラインと 1~2段落分の雑な文章を 自分の手で書く

- 残りの部分を LLM に書かせるが 一塊は300語前後までに区切る

- 手作業で次を挿入する

- 600~800語ごとに 小さな脱線話を1つ

- 自分の実体験 授業での例 住んでいる地域など 具体的な例を1つ

- 一番ロボットっぽく聞こえる箇所だけを選び Casual スタイルで Clever Ai Humanizer に通す 自分の体験部分には触れない

- 最後の5分仕上げで

- 2~3個の典型的な「AIっぽいフレーズ」を削除

- あまりにも滑らかなつなぎを1~2箇所わざと崩す

- 自分がふだん本当に言いそうな 少し雑な一文を足す

そのうえで 実際に使われる検出ツールにかける まだ強く警告が出るなら 文書全体ではなく 指摘された部分だけを書き直す

まとめると

Clever Ai Humanizer は持っておいて損のないツールだが 本当の「人間らしさ」は ツールが処理し終えたあとに あなた自身の雑で主観的な編集を重ねたところで生まれる それを使って「自分の指紋を消す」のではなく 「整えつつ ちゃんと残す」ほうに使うとよい