Ik ben op zoek naar een echt effectieve gratis alternatieve tool voor het AI-humanizerhulpmiddel van GPTinf. De content die ik genereer wordt telkens als door AI geschreven aangemerkt door verschillende detectors, en de gratis opties van GPTinf zijn ofwel beperkt of leveren geen consistente resultaten op. Kan iemand een betrouwbaar gratis hulpmiddel of een workflow aanraden die helpt tekst door gangbare AI-detectietools te laten komen zonder de leesbaarheid te verpesten?

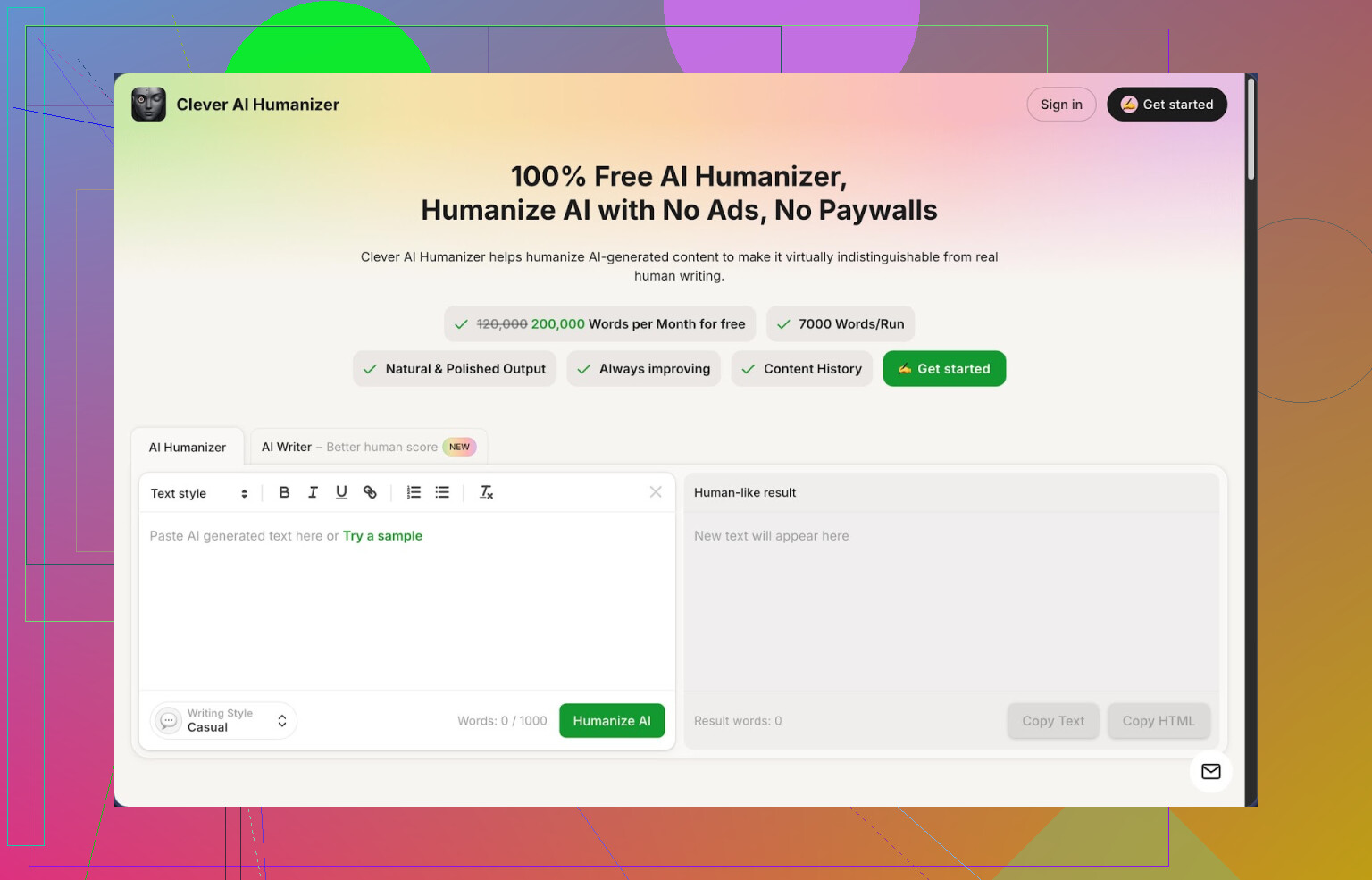

1. Clever AI Humanizer review

Clever AI Humanizer is degene waar ik steeds weer op terugkom wanneer mensen vragen om een gratis AI‑humanizer die niet waardeloos wordt na 3 prompts.

Dit is wat ik na een paar dagen zag toen ik het behoorlijk zwaar belastte:

- Gratis versie geeft ongeveer 200.000 woorden per maand

- Tot 7.000 woorden in één keer

- Drie outputstijlen: Casual, Simpel Academisch, Simpel Formeel

- Ingebouwde AI‑schrijver zodat je op één plek kunt schrijven en humanizen

Op ZeroGPT, met de Casual‑stijl, lieten mijn testteksten 0% AI zien bij drie verschillende samples. Ik vertrouw geen enkele detector volledig als eindjurylid, maar als je docent, manager of klant vastzit aan dat soort tools, helpt het wel.

Ik schrijf veel met AI en het patroon is altijd hetzelfde: de tekst voelt stijf, detectors schreeuwen 100% AI, en als je het met de hand te veel probeert te herstellen, verspil je een uur aan een concept van 1.000 woorden. Daarom ben ik dit jaar opnieuw op zoek gegaan naar humanizers en ben ik langer dan verwacht bij deze gebleven.

Zo werkt het hoofdonderdeel in de praktijk.

Je plakt je AI‑tekst, kiest een stijl (ik gebruik meestal Casual voor blogs en Simpel Academisch voor rapporten), drukt op de knop en je krijgt binnen een paar seconden een nieuwe versie. De output probeert het typische AI‑ritme te doorbreken, voegt wat oneffenheid toe en houdt de structuur grotendeels intact. Ik heb voor een paar klantartikelen origineel en output naast elkaar gelegd, en de betekenis bleef netjes op koers zonder willekeurige feiten of verzonnen bronnen.

De hogere woordlimiet maakt uit. Ik gooi vaak documenten van 5.000 woorden uit ChatGPT of Claude er in één keer in, in plaats van ze in kleine stukjes te hakken en te hopen dat de toon consistent blijft. Met 200k woorden per maand ben ik gestopt met tokens tellen, wat één zorg minder in de workflow gaf.

Wat me tijdens het nakijken opviel, is dat de tool je bedoeling niet sloopt. Hij duwt aan de formulering, verandert zinsvormen en herschikt kleine stukjes, maar draait je beweringen niet om en herschrijft je redeneringen niet tot iets anders. Bij essays waar de bewoording gevoelig ligt, lees ik nog steeds zorgvuldig na, maar ik hoef zelden hele alinea’s terug te draaien.

Buiten de hoofd‑humanizer zijn er een paar extra modules die nuttig bleken toen ik drie verschillende tabbladen door één pagina wilde vervangen.

De Free AI Writer is voor wanneer je nog geen concept hebt. Je geeft een onderwerp, een korte prompt of een ruwe opzet, en hij spuugt een essay, blogpost of artikel uit. Van daaruit kun je diezelfde tekst direct door de humanizer sturen zonder de interface te verlaten. Toen ik deze combinatie testte, waren de human‑scores op detectors zoals ZeroGPT en GPTZero meestal beter dan wanneer ik een generieke ChatGPT‑output kopieerde en daarna pas humanizete, waarschijnlijk omdat de oorspronkelijke generatie al is afgestemd op dit gebruik.

De Free Grammar Checker is simpel. Je plakt tekst, hij fixt automatisch spelling, komma’s, congruentie en enkele formuleringproblemen. Ik heb een paar stukken door zowel deze tool als Grammarly gehaald. Grammarly ving nog steeds meer nuance en stijldingen op, maar voor een snelle opschoonbeurt voordat je iets naar een klant stuurt of online zet, was dit meestal genoeg.

De Free AI Paraphraser Tool is waar ik uiteindelijk meer tijd doorbracht dan verwacht. Als je een oude draft, klantbriefing of productbeschrijving hebt en je hebt een andere toon nodig terwijl de feiten hetzelfde blijven, haal je het hier doorheen. Voor SEO‑werk of het updaten van verouderde posts hielp het me alternatieve versies te maken die niet lazen als gespinde rommel. Ik testte het op een koopgids van 2.500 woorden en de structuur bleef hetzelfde terwijl de bewoording genoeg verschoof zodat plagiaattools geen problemen gaven.

Alles bij elkaar krijg je vier tools in één interface: humanizer, writer, grammar checker en paraphraser. De workflow waar ik uiteindelijk op uitkwam, ziet er zo uit:

- Schrijven in ChatGPT of met hun AI Writer

- Het volledige stuk door de Humanizer halen in Casual of Simpel Academisch

- De output scannen en rare formuleringen opschonen met Grammar Checker

- Paraphraser gebruiken voor stukken waar een klant een tweede toonoptie wil

Dit haalde tijd van mijn gebruikelijke proces af, omdat ik niet steeds hoefde te springen tussen meerdere sites met verschillende woordlimieten en tokensystemen.

Is het perfect. Nee.

Sommige detectors markeren delen van de tekst nog steeds als AI. GPTZero markeerde bijvoorbeeld soms lange, academische alinea’s als gedeeltelijk AI, zelfs na humanizen. Als je school of bedrijf streng is, moet je nog steeds je eigen bewerkingen toevoegen, secties omgooien of persoonlijke details toevoegen om veiliger te zitten.

Het aantal woorden heeft ook de neiging te groeien. Bij het herschrijven worden zinnen vaak langer in plaats van korter. Een artikel van 1.500 woorden uit ChatGPT kwam meerdere keren op 1.900 woorden uit na humanizen. Als je harde woordlimieten hebt, moet je achteraf zelf gaan schrappen.

Zelfs met die punten blijft het, voor iets dat op het moment dat ik dit schrijf nog volledig gratis is, de tool die ik als eerste aanraad wanneer iemand een humanizer nodig heeft en weigert abonnementskosten te betalen.

Als je een langere uitleg met screenshots en meer AI‑detectie‑bewijzen wilt, staat hier een volledige write‑up: https://cleverhumanizer.ai/community/t/clever-ai-humanizer-review-with-ai-detection-proof/42

Een video‑walkthrough vind je hier, waar iemand stap voor stap door de tests gaat:

Clever AI Humanizer Youtube review https://www.youtube.com/watch?v=G0ivTfXt_-Y

Als je wilt zien wat andere gebruikers zeggen en tools wilt vergelijken, hebben deze Reddit‑threads mij geholpen:

Beste AI‑humanizers op Reddit https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=nl

Alles over AI humanizen https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai?tl=nl/

Korte versie omdat je vroeg om iets dat werkt: er is geen magische one‑click “ondetecteerbaar” knop, maar je kunt er gratis dicht bij komen als je tools mixt met je eigen bewerkingen.

Een paar opties die voor mij werkten:

- Clever Ai Humanizer

Ik ben het met veel van wat @mikeappsreviewer zei eens, maar ik zie het niet als een fire and forget oplossing.

Wat ik anders doe:

• Ik gebruik kortere stukken, 800 tot 1200 woorden, geen hele blokken van 5k. De output blijft natuurlijker.

• Ik pas altijd de eerste en laatste 2–3 zinnen met de hand aan. Detectors zijn dol op formulematige intro’s en afsluitingen.

• Ik vermijd een volledig academische toon als de uiteindelijke inzet schoolwerk is. Ik mix Casual of Simple Formal en voeg daarna mijn eigen vakspecifieke zinnen toe.

Op ZeroGPT en GPTZero krijg ik hierna vaak “meestal menselijk”. Niet perfect. Genoeg om directe auto‑flags te voorkomen.

- Multi‑pass herschrijf methode met gratis tools

Als je niet van één humanizer afhankelijk wilt zijn, werkt deze combinatie goed:

Stap 1: Genereren met een willekeurige LLM, houd het kort.

Schrijf in blokken van 300–500 woorden. Lange monotone stukken triggeren detectors.

Stap 2: Parafraseren in stukken.

Gebruik de parafrase‑functie van Clever Ai Humanizer of een andere gratis parafraser. Verander de bewoording maar behoud de feiten.

Belangrijk hier: parafraseer niet het hele document in één keer. Detectors pikken herhaalde ritmes op.

Stap 3: Persoonlijke ruis toevoegen.

Voeg handmatig dingen in die huidige LLM’s vaak vermijden:

• Af en toe korte, onvolledige zinnen.

• 1–2 kleine typefouten die je op duidelijke plekken herstelt, maar laat 1 subtiele typo of rare formulering staan.

• Specifieke verwijzingen: jouw stad, de precieze opdrachttekst van je docent, je eigen eerdere werk, voorbeelden uit de les.

Stap 4: Variatie in zinslengte.

Neem één alinea en dwing variatie af:

• Eén regel met 5–8 woorden.

• Een langere regel van ongeveer 25–30 woorden.

• Daarna een normale van rond de 15 woorden.

Mensen doen dit vaak. AI‑output blijft vaak in een smalle bandbreedte.

-

Structurele edits waar detectors een hekel aan hebben

De meeste mensen veranderen alleen woorden. Detectors kijken naar structuur. Probeer dit:

• Verwissel twee alinea’s in het midden.

• Voeg twee korte alinea’s samen tot één.

• Voeg één korte alinea toe met een duidelijke mening of persoonlijke stelling.

• Verander kopjes naar iets minder generieks. -

Waar je niet blind op moet vertrouwen

Ik ben het niet helemaal eens met het zwaar leunen op één enkele detector‑screenshot als bewijs.

Mijn tests:

• Dezelfde tekst kwam door ZeroGPT als menselijk maar scoorde 80–90 procent AI op Originality.

• Na handmatige edits plus een ronde met Clever Ai Humanizer gingen alle drie (ZeroGPT, GPTZero, Originality) richting “gemengd” of “waarschijnlijk mens”.

Als je docent of baas maar één gratis detector gebruikt, hoef je in de praktijk alleen op die er goed uit te zien. Voor klanten of openbare blogs mik ik op “gemengd” over meerdere tools, en dan stop ik met erover te stressen.

- Praktische workflow die je kunt kopiëren

Hier is een basic flow die alles gratis houdt:

- Schrijf met een willekeurige LLM in kleine secties.

- Haal elke sectie door Clever Ai Humanizer met Casual of Simple Formal.

- Parafraseer 1–2 hardnekkige alinea’s nog eens met een andere gratis parafraser.

- Handmatig:

• Verander zinslengtes.

• Voeg 1–2 kleine persoonlijke details in.

• Corrigeer een deel van de fouten maar laat de tekst lichtjes imperfect. - Haal je definitieve document door dezelfde detector die je docent of klant gebruikt en pas alleen de slechtst gemarkeerde stukken aan.

Laatste punt. Als dit voor school is en ze zijn streng, bescherm je jezelf door je eigen redenering toe te voegen. Gebruik je eigen voorbeelden, je eigen fouten, je eigen bronnen. Geen enkele tool vervangt dat. De humanizer helpt, maar jouw bewerkingen zijn wat het echt over de streep trekt.

Als je doel is om nooit meer geflagd te worden, jaag je een luchtspiegeling na. Detectors zijn probabilistische gokmachines, geen leugendetectors. Maar je kunt je trefkans wel flink omlaag krijgen zonder te betalen voor GPTinf.

Omdat @mikeappsreviewer en @jeff Clever Ai Humanizer zelf en een paar multipass‑trucs al hebben doorgelopen, is dit wat ik zou toevoegen dat echt afwijkt van hun aanpak:

1. Gebruik Clever Ai Humanizer omgekeerd ten opzichte van de meeste mensen

Iedereen:

LLM → lange eerste versie → humanizer → bidden → detector.

Wat voor mij beter werkt:

- Maak met de hand een outline (koppen + 2–3 bulletpoints per sectie).

- Schrijf per sectie eerst zelf een ruwe, korte alinea, ook al is die lelijk.

- Geef die aan Clever Ai Humanizer en vraag om te verbeteren in plaats van alles te herschrijven.

Je eindigt met tekst die nog steeds jouw structuur heeft, jouw rare formuleringen en net genoeg polish. Detectors lijken een hekel te hebben aan volledig machine‑gestructureerde stukken, nog meer dan aan machine‑geformuleerde zinnen.

2. Herschrijf niet altijd alles

Ik ben het eigenlijk niet helemaal eens met de mentaliteit van elke sectie door een tool halen.

Probeer dit:

- Genereer met je LLM.

- Haal alleen de meest AI‑achtige alinea’s door Clever Ai Humanizer (die klinken als generieke blogspam of schoolboek‑intro’s).

- Laat 20–30% van de tekst volledig van jou: kleine rants, voorbeelden uit je eigen leven, zijpaadjes.

Detectors leunen zwaar op consistentie. Een perfect consistente toon over 1.500+ woorden is verdacht. Een paar ruwe, haperende stukken helpen.

3. Verander informatiedichtheid, niet alleen stijl

Detectors letten niet alleen op toon. Ze kijken ook naar hoe strak feiten en overgangen op elkaar zitten.

Tools als Clever Ai Humanizer zijn prima, maar gebruik ze om:

- Een of twee irrelevante maar plausibele zijpunten toe te voegen.

- Een overgang weg te halen zodat de flow een tikje stroef wordt.

- Te nette redeneringen te breken: menselijke argumenten dwalen wat rond.

In plaats van:

“Ten eerste X. Ten tweede Y. Tot slot Z.”

Probeer:

“Ten eerste X. Ik heb ook gevallen gezien waarin A gebeurt. Daarna Y. Z is in sommige situaties eigenlijk optioneel.”

Je kunt het die kant op sturen met een korte instructie voor je plakt:

“Laat dit wat meer afdwalen en minder als een schoolboek klinken. Houd kleine zijwegen erin.”

4. Stop met jagen op 0% AI op elke detector

Onpopulaire mening: als je tekst op één of twee grote tools op gemengd of waarschijnlijk menselijk uitkomt, is dat meestal genoeg. Ik heb gehad:

- 10–20% AI op de ene detector

- 70% mens op een andere

- “Onzeker” op een derde

Niemand heeft een universele standaard. Obsessief 0% halen op ZeroGPT, GPTZero, Originality, enz., is hoe je uren verliest en toch verliest.

Praktische doelstelling:

- Eén keer door Clever Ai Humanizer voor de stroeve stukken.

- Lichte handmatige edits zoals @jeff voorstelde.

- Alleen draaien door de specifieke detector die je docent, klant of platform gebruikt, niet door elke tool op internet.

5. Gebruik Clever Ai Humanizer als ruisgenerator, niet alleen als polijsttool

Je kunt het wat oprekken:

- Voer je tekst in en vraag expliciet om “licht inconsistente toon” of “mix van casual en semi‑formeel”.

- Vraag om 1–2 onhandige formuleringen te laten staan “zodat het niet te gepolijst klinkt”.

Laat daarna een deel van die ruwheid staan. Ga er niet alles weer overheen halen met grammaticatools. Mensen zijn rommelig. Perfecte grammatica over 2.000 woorden schreeuwt LLM harder dan één typefout.

6. Als dit voor school is, dek jezelf in

Geen enkele tool, ook Clever Ai Humanizer of GPTinf niet, beschermt je tegen regels die elke AI‑hulp verbieden. Als je school of werk streng is:

- Zorg dat je je argumenten hardop kunt uitleggen zonder spiekbriefje.

- Bewaar eerdere handgeschreven of ruwe versies als bewijs dat je zelf gewerkt hebt.

- Verander minstens één voorbeeld of casus naar iets dat echt in jouw les, baan of stad is gebeurd.

Zelfs de beste AI‑humanizer is er alleen om je proces soepeler te maken, niet om als schild te dienen als iemand serieus gaat onderzoeken.

TL;DR:

Ja, Clever Ai Humanizer is een van de weinige gratis tools die echt verschil maakt, zeker als je klaar bent met de limieten van GPTinf. Zie het alleen niet als een magische onzichtbaarheidsmantel. Combineer het met je eigen structuur, je eigen inhoud, en stop met jagen op 0% op elke detector, anders ben je meer tijd kwijt aan het verslaan van de scanner dan aan echt leren of schrijven.

Korte versie: er is geen perfecte “AI → mens” knop, maar je krijgt betrouwbaar minder detecteerbare content door anders met humanizers om te gaan, niet alleen door een andere tool te kiezen.

Ik sla over wat @jeff en @mikeappsreviewer al noemden (chunking, zinsvariatie, structurele tweaks) en wat @stellacadente toevoegde over gemengde tools, en focus op invalshoeken waar zij minder op leunden.

1. Gebruik ruis op ophetniveau van het onderwerp, niet alleen zin-voor-zin herschrijven

De meeste mensen veranderen alleen de bewoording. Detectors kijken ook naar:

- Hoe “op rails” de redenering loopt

- Hoe strak de overgang tussen onderwerpen is

- Hoe gebalanceerd de behandeling aanvoelt

Truc die veel helpt:

- Genereer of schrijf eerst je stuk.

- Voeg vóór je Clever Ai Humanizer gebruikt één of twee kleine “off-topic maar gerelateerde” microsecties zelf toe. Bijvoorbeeld:

- Een korte anekdote

- Een kort stukje “hier werkte dit niet voor mij”

- Eén alinea waarin je toegeeft dat je ergens niet zeker van bent

Die menselijk ogende “imperfecties” op ideeniveau tellen zwaarder dan alleen synoniemen wisselen.

Stuur daarna alleen die omliggende alinea’s door Clever Ai Humanizer zodat de stijl mengt, maar jouw inhoudelijke eigenaardigheden blijven staan.

2. Wissel bronnen van AI af, niet alleen humanizers

Hier wijk ik een beetje af van iedereen die zo sterk op één vaste stack leunt.

Als je altijd met hetzelfde LLM genereert en altijd met dezelfde humanizer opschoont, wordt je vingerafdruk voorspelbaar. Voor gratis workflows:

- Gebruik één LLM voor de outline + ruwe eerste versie

- Gebruik een andere gratis LLM om slechts 10–20% van de tekst te herschrijven

- Laat dan alles door Clever Ai Humanizer gaan voor het gladstrijken van de toon

Die mix van “stemmen” plus menselijke tweaks fopt detectors beter dan dezelfde tekst drie keer door hetzelfde model duwen.

3. Clever Ai Humanizer: echte plus- en minpunten die ertoe doen

Pluspunten:

- Echt hoge gratis woordlimiet, je bent niet meteen klaar na een paar pogingen.

- Kan lange input aan zonder je structuur te slopen.

- Stijlen als Casual / Simple Academic zijn daadwerkelijk verschillend genoeg om in één document te mixen.

- Werkt goed als afwerker na andere tools, niet alleen als hoofd-humanizer.

Minpunten:

- Vergroot vaak het aantal woorden, wat lastig kan zijn bij strakke limieten.

- Output kan nog steeds “te netjes” voelen als je niet handmatig kleine foutjes terugbrengt.

- Bij volle academische stijl gaan sommige detectors nog steeds af op grote alinea’s.

- Je kunt gemakzuchtig worden en stoppen met zelf inhoudelijk nadenken, en dat is precies wat je in de problemen brengt bij strenge docenten.

Ik ben het dus met @mikeappsreviewer eens dat Clever Ai Humanizer een van de weinige gratis tools is die detector-scores echt beïnvloedt, maar ik zou het nooit 100% van mijn tekst laten aanraken.

4. Micro-patronen breken die bijna niemand aanpakt

Iedereen heeft het over zinslengte-variatie. Wat ik detectors de laatste tijd echt zie oppikken:

- Overmatig gebruik van “Tot slot”, “Al met al”, “Daarnaast” enzovoort. Schrap of vervang die.

- Perfect parallelle lijstjes: “Ten eerste…, Ten tweede…, Ten derde…” Mix dat of doorbreek het patroon.

- Volledig neutrale toon. Voeg 2–3 emotioneel geladen zinnen toe: “Dit is eerlijk gezegd irritant…” “Dit deel vind ik verwarrend…”

Doe dit met de hand na Clever Ai Humanizer. Slechts een doorgang van 3–5 minuten waarin je:

- Minstens twee generieke overgangsfrasen verwijdert

- Om de paar alinea’s één sceptische of meningsgerichte zin toevoegt

- Bewust één wat houterige formulering laat staan die klinkt als jij, niet als een copywriter

Die kleine ronde plus een humanizer verplaatst je vaak van “duidelijk AI” naar “gemengd/onzeker” bij strengere tools.

5. Vertrouw geen enkele detector (of reviewer) volledig

Je zag het al in de andere reacties:

- @jeff leunt op structurele edits

- @stellacadente op workflowlogica

- @mikeappsreviewer op longform-humanization met Clever Ai Humanizer

Dat werkt allemaal soms. Ik heb dezelfde tekst gehad die:

- Als “waarschijnlijk menselijk” door de ene detector kwam

- En “sterke AI-signalen” kreeg bij een andere

Dus in plaats van overal 0% AI na te jagen, doe je beter dit:

- Zoek uit welke detector de echte beoordelaar gebruikt (docent, klant, baas, platform).

- Optimaliseer vooral daarvoor en doe alleen een sanity check met 1 extra tool.

- Zodra je bij allebei op “gemengd” of “meestal menselijk” zit, stop je en ga je verder.

6. Concrete hybride workflow die niet exact hun stappen herhaalt

Probeer deze variant als je iets anders wilt dan de eerdere antwoorden:

- Maak je outline en 1–2 rommelige alinea’s met de hand.

- Laat een LLM de rest invullen, maar beperk elke chunk tot ongeveer 300 woorden.

- Voeg handmatig in:

- Eén kleine zijstap per 600–800 woorden

- Eén voorbeeld uit je echte leven, je klas of je stad

- Stuur alleen de meest robotachtige stukken naar Clever Ai Humanizer in Casual-stijl. Laat je persoonlijke delen ongemoeid.

- Laatste ronde van 5 minuten:

- Verwijder 2–3 generieke “AI-zinnen”

- Breek 1 of 2 perfecte overgangen

- Voeg één onvolmaakte zin toe die jij ook echt zo zou zeggen

Laat het daarna door de specifieke detector gaan die tegen je gebruikt wordt. Als die nog steeds schreeuwt, herschrijf dan alleen het gemarkeerde deel, niet het hele document.

Bottom line:

Clever Ai Humanizer is het waard om in je gereedschapskist te hebben, maar de echte “vermenselijking” gebeurt waar hun tool stopt en jouw rommelige, uitgesproken aanpassingen beginnen. Gebruik het om te polijsten, niet om je eigen vingerafdrukken uit te wissen.