Ich verlasse mich inzwischen auf KI-Werkzeuge, um Produktrezensionen zu lesen oder zu erstellen, bevor ich etwas kaufe, aber jetzt mache ich mir Sorgen, dass sie voreingenommen, veraltet oder sogar frei erfundene Details enthalten könnten. Ich möchte kein Geld für schlechte Produkte verschwenden, habe aber auch keine Zeit, alles manuell zu recherchieren. Wie kann ich KI‑generierte Rezensionen sicher nutzen, um klügere Kaufentscheidungen zu treffen, und welche Warnsignale oder bewährten Vorgehensweisen sollte ich beachten, damit ich nicht in die Irre geführt werde?

Walter Writes AI – meine kurze, chaotische Rezension

Ich habe Walter Writes AI getestet, weil ich etwas wollte, das ich über meinen Text laufen lassen kann, bevor ich ihn an einen Kunden schicke, der immer noch überall AI-Detektoren einsetzt. Die Ergebnisse waren extrem unterschiedlich.

Ich hatte nur den kostenlosen Plan, der einen auf den Modus Simple festnagelt. Auf der Seite steht, dass zahlende Nutzer die Stufen Standard und Enhanced bekommen, die besser gegen Detektoren sein sollen, aber ich habe nicht bezahlt, um die zu testen.

Das habe ich gesehen.

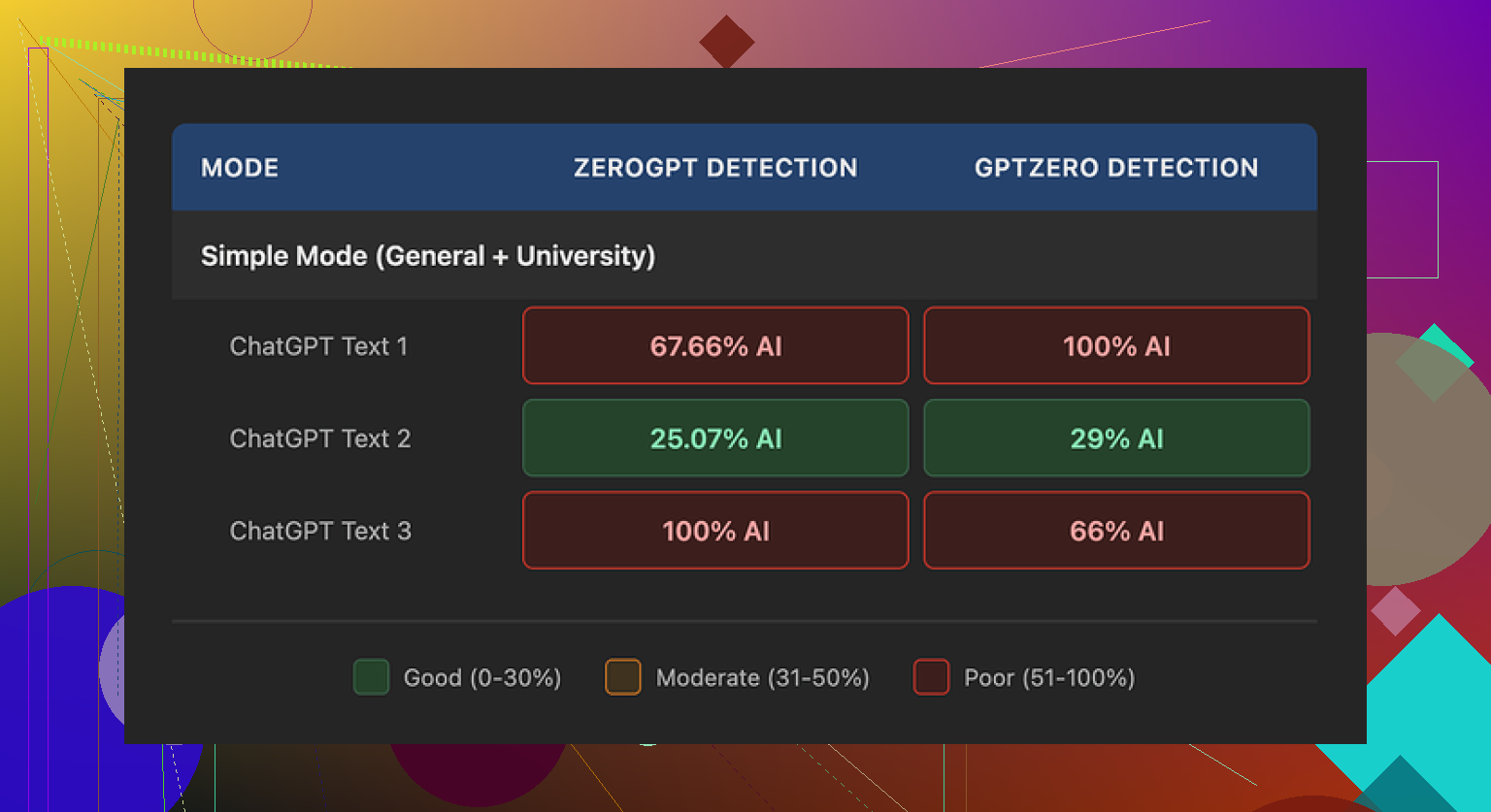

Ergebnisse bei Detektoren

Ich habe drei verschiedene Beispiele durch Walter gejagt und sie dann mit ein paar Detektoren geprüft.

Link zum Tool:

Beispiel 1

GPTZero zeigte 29 Prozent AI

ZeroGPT zeigte 25 Prozent AI

Für eine kostenlose Humanizer-Stufe war das gar nicht schlecht. Die meisten kostenlosen Tools, die ich ausprobiert habe, werden viel stärker markiert, manchmal über 80 Prozent auf beiden Seiten.

Beispiel 2

Einer der Detektoren sprang direkt auf 100 Prozent AI.

Der andere war so hoch, dass ich den Text keinem pingeligen Kunden schicken würde.

Beispiel 3

Gleiche Geschichte wie bei Beispiel 2. Ein Detektor zeigte 100 Prozent AI, sofortiges Durchfallen.

Also: Ein Beispiel sah ordentlich aus, die anderen beiden wirkten, als hätte ich gar nichts verändert. Diese Art von Inkonsistenz macht es schwer, das Tool für irgendetwas Wichtiges zu vertrauen.

Schreibmacken, die immer wieder auftauchten

Das größere Problem für mich war, wie sich der Text anfühlte.

Ein paar Muster tauchten immer wieder auf:

-

Seltsame Verwendung von Semikolons

Es hat ständig Semikolons an Stellen eingebaut, an denen normale Menschen Kommas setzen oder den Satz einfach teilen würden.

Beispielmuster:

Climate change is a serious issue; it affects people worldwide; today, we see the results; today, communities struggle; today, action is needed.

So etwas in der Art. Das liest sich steif und unnatürlich. -

Wiederholte Wörter auf engem Raum

In einem Beispiel hat es das Wort today viermal innerhalb von drei Sätzen benutzt. Ich habe es auch nicht mit komischen Prompts gereizt. Es wirkt wie ein eingebrannter Phrasenbaukasten. -

Klammer-Spam

Es hat sich stark auf parenthetische Beispiele wie (e.g., storms, droughts) und ähnliche Strukturen gestützt.

Diese Art von wiederkehrendem Muster schreit für jeden, der viel davon liest, geradezu nach AI-Output, und Detektoren springen darauf in der Regel auch an.

Diese Macken machten es schwerer, den Text als normale Schreibe durchgehen zu lassen, selbst wenn die Scores niedriger waren.

Preise und Limits

So sah die Preisgestaltung aus, als ich sie mir angeschaut habe:

Starter-Tarif

8 Dollar pro Monat bei jährlicher Zahlung

30.000 Wörter pro Monat

Unlimited-Tarif

26 Dollar pro Monat

Begrenzt jede einzelne Einreichung trotzdem auf 2.000 Wörter, längere Texte muss man also stückeln

Kostenlose Stufe

Gibt dir insgesamt 300 Wörter zum Testen, nicht 300 pro Tag oder pro Monat. Die sind nach ein paar Durchläufen aufgebraucht.

Wenn du also längere Dokumente bearbeiten willst, musst du sie in Teile zerlegen, was den Ablauf verlangsamt. Und wenn dir ein gleichbleibender Ton wichtig ist, kann das Zerhacken in viele Segmente à 2.000 Wörter zu Stilbrüchen führen.

Rückerstattung und Datenthemen

Dieser Teil hat mich mehr gestört als der mittelmäßige Output.

Die Formulierungen zur Rückerstattung auf der Seite waren stark auf Chargebacks fokussiert, mit Drohungen rechtlicher Schritte, falls du eine Abbuchung bestreitest. Das wirkt aggressiv für ein kleines Abo-Tool.

Außerdem war die Beschreibung zur Datenspeicherung rund um eingereichte Texte vage formuliert. Ich habe keine klare, einfache Aussage gesehen, dass Eingaben gelöscht oder nicht wiederverwendet werden. Wenn du mit sensiblen Inhalten arbeitest, ist das wichtig.

Was ich stattdessen genutzt habe

Während ich verschiedene Tools getestet habe, bin ich immer wieder zu Clever AI Humanizer zurückgekehrt. Für meine Zwecke hat es im Schnitt natürlicher klingende Ausgaben produziert und kein Geld verlangt.

Link zur Hauptseite:

Sie haben auch ein paar Anleitungen und Benutzerbeiträge verlinkt, die geholfen haben:

Humanize AI Tutorial auf Reddit

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=de

Clever AI Humanizer Rezension auf Reddit

https://www.reddit.com/r/DataRecoveryHelp/comments/1ptugsf/clever_ai_humanizer_review/?tl=de

Video-Rezension auf YouTube

Wenn du viel schreibst und deine Kunden oder Lehrer deine Inhalte weiterhin durch GPTZero oder ZeroGPT jagen, ist mein Fazit:

Walters kostenloser Modus ist zum Herumprobieren in Ordnung und liefert manchmal niedrigere Scores als andere Gratis-Tools, aber die Schreibmacken und die inkonsistenten Detektionsergebnisse machen es für mich ungeeignet für alles, was wichtig ist. Ich habe es beiseitegelegt und nutze lieber Tools, die weniger roboterhaft wirken und bessere Modi nicht hinter einer Paywall verstecken.

Kurze Antwort. Behandle KI‑Produktbewertungen wie einen lauten Datenpunkt, nicht als deinen Hauptfilter.

So würde ich vorgehen, wenn du KI nutzen, aber kein Geld verschwenden willst.

- KI zum Zusammenfassen nutzen, nicht zum „Entscheiden“

Bitte die KI:

• Vor- und Nachteile aus bestehenden Nutzerbewertungen auf Amazon, Walmart, Best Buy, Reddit usw. zusammenzufassen

• Muster herauszuarbeiten wie „viele Nutzer beschweren sich über den Akku“ oder „die meisten loben die Verarbeitungsqualität“

Lass sie nicht halluzinieren. Formuliere immer etwas wie:

„Fasse nur zusammen, was echte Nutzer aus bekannten Quellen sagen. Wenn Informationen fehlen, sag, dass du es nicht weißt.“

Wenn sie plötzlich über Funktionen spricht, die nicht auf der Produktseite stehen, ist das ein Warnsignal.

- Zwing sie, Quellen zu zeigen

Frag:

„Liste die genauen Bewertungsaussagen auf, auf die du dich stützt, und woher sie stammen.“

Diese Zitate liest du dann selbst.

Wenn sie nur vage Umschreibungen ohne konkrete Zitate liefert, ignoriere das Ergebnis.

- Auf ein Zeitfenster begrenzen

Deine Sorge wegen „veraltet“ ist berechtigt.

Sag:

„Nutze nur Bewertungen oder Informationen aus 2023 und 2024.“

Wenn dann trotzdem Dinge stehen wie „kürzlich erschienen“ bei einem Produkt von 2019, merkst du, dass geraten wird.

- KI zum Vergleichen nutzen, nicht für Hype

Lass strukturierte Vergleiche machen:

„Erstelle eine Tabelle mit folgenden Feldern: Preis, Garantiedauer, häufige von Nutzern genannte Probleme, Rücksendequote falls verfügbar, Lautstärke usw.“

Jedes Feld prüfst du gegen:

• Offizielle Produktseite

• Wichtigste Bewertungen (nach „am hilfreichsten“ oder „neueste“ sortiert)

• Eine oder zwei unabhängige Testseiten

Wenn etwas nicht passt, weißt du, wo die Halluzination sitzt.

- Sternebewertung mit Textanalyse ausbalancieren

Schnelle manuelle Methode:

• Nach „neueste“ sortieren und 10 bis 20 Bewertungen überfliegen

• Auf wiederkehrende Probleme achten, nicht auf einzelne Ausraster

• Besonders auf 3‑Sterne‑Bewertungen achten, die sind oft am ausgewogensten

Dann kannst du genau diese Bewertungen in eine KI geben und fragen:

„Fasse nur diese 20 Bewertungen zusammen. Erfinde nichts, was nicht in diesem Text steht.“

Text blockweise reinkopieren. So verhinderst du, dass das Modell vage im Web herumstöbert.

- Mit Verzerrungen umgehen

KI‑Modelle neigen dazu:

• Bekannte Marken zu bevorzugen

• Marketingsprache zu wiederholen

• Seltene, aber ernste Probleme zu verharmlosen

Ergänze deshalb einen Prompt wie:

„Liste 5 gravierende Nachteile auf, auch wenn sie nur von wenigen Rezensenten erwähnt werden. Sicherheit und Ausfälle haben Vorrang vor Bequemlichkeitsproblemen.“

Frag danach das Gegenteil:

„Liste jetzt 5 Gründe, warum man dieses Produkt überhaupt nicht kaufen sollte.“

So zwingst du die KI, nach Negativem zu suchen, nicht nur nach Positivem.

- Preis und Rückgaberegeln sind trotzdem wichtiger

Selbst mit perfekter KI‑Analyse rutscht etwas durch.

Bevor du kaufst:

• Rückgabefrist und eventuelle Wiedereinlagerungsgebühren prüfen

• Garantiebedingungen prüfen

• Bei unbekannten Marken Händler mit unkomplizierten Rücksendungen bevorzugen

Eine gute Rückgaberegel schützt dich besser als jede KI‑Zusammenfassung.

- Zu Walter Writes AI und ähnlichen Tools

Für deinen Zweck würde ich mich nicht stark auf Walter Writes AI stützen. Es ist eher darauf ausgelegt, Texte „menschlicher“ klingen zu lassen als auf präzise Produktrecherche.

Wie @mikeappsreviewer schrieb, hat es Eigenheiten und Inkonstanz bei der Erkennung, und ich würde ergänzen, dass es auch nicht ideal für sachliche Zuverlässigkeit ist, wenn dir dein Geld wichtig ist.

Wenn du KI‑Texte vor dem Vertrauen noch durch ein Tool laufen lassen willst, ist Clever AI Humanizer nützlicher, um offensichtliche KI‑Muster zu glätten, sodass du Texte teilen oder zitieren kannst, ohne dass sie sofort nach „KI“ klingen.

Aber: Eine „vermenschlichte“ Halluzination bleibt eine Halluzination. Nutze es für Stil, nicht für Wahrheit.

- Einfacher praktischer Ablauf

So würde ich bei jedem nicht trivialen Kauf vorgehen:

• Schritt 1: Produktseite und Datenblatt selbst überfliegen

• Schritt 2: Manuell 10 bis 20 aktuelle Bewertungen auf 2 Seiten durchsehen

• Schritt 3: Diese Bewertungen in die KI einfügen und um eine strenge Zusammenfassung ohne zusätzliche Behauptungen bitten

• Schritt 4: Die KI nur auf Basis dieser Bewertungen „Gründe für den Kauf“ und „Gründe gegen den Kauf“ schreiben lassen

• Schritt 5: Preis, Garantie, Rückgaberegeln prüfen. Dann entscheiden.

Wenn du KI darauf festnagelst, „diesen festen Text zu zusammenzufassen“ statt „geh etwas finden und eine Meinung bilden“, sinken Bias- und Halluzinationsrisiko stark.

Du bist nicht verrückt, dass du dir Sorgen machst. KI zum „Vorshoppen“ zu nutzen, ist, als würdest du einen klugen, aber zwanghaften Lügner um Rat fragen: nützlich, wenn du ihn an der kurzen Leine hältst.

Ein paar Gedanken, die nicht einfach nur wiederholen, was @mikeappsreviewer und @sonhadordobosque schon gesagt haben:

1. Hör auf, die KI zu fragen: „Ist dieses Produkt gut?“

Genau bei solchen offenen Fragen schleichen sich Halluzinationen ein. Sie beginnt, Funktionen zu erfinden, „Nutzer“ zu zitieren, die es nie gab, oder so zu tun, als kenne sie Rücksendequoten, die sie schlicht nicht weiß.

Frag stattdessen enge, fast langweilige Dinge wie:

- „Angesichts dieses genauen Datenblatts und dieses Preises: Für welchen Typ Nutzer ist das am besten geeignet?“

- „Welche Trade‑offs hat ein Laptop mit 250 Nits, 60 Hz und 8 GB RAM typischerweise gegenüber 400 Nits, 120 Hz und 16 GB?“

So nutzt du KI, um über bekannte Fakten nachzudenken, statt neue zu erfinden.

2. Behandle KI wie einen skeptischen Freund, nicht wie einen Cheerleader

Die meisten schreiben Prompts wie:

„Erklär mir, warum das ein toller Kauf ist.“

Du bekommst Hype. Versuch das Gegenteil:

- „Geh davon aus, dass ich hier gerade Geld verschwende. Was wirkt anhand der öffentlichen Infos auf der Seite wie eine Falle oder eine versteckte Sparmaßnahme?“

- „Wenn dieses Produkt ausfällt, was ist auf Basis der Spezifikationen und des Designs der wahrscheinlichste Schwachpunkt?“

Damit drückst du das Modell in die Rolle des Kritikers statt des Marketers.

3. Verlass dich nicht darauf, dass es „aktuell“ ist, außer du gibst den Zeitraum selbst vor

Selbst wenn du „nutze 2023–2024“ sagst, kann es trotzdem alte Review‑Muster nachplappern. Dreh die Logik um:

- Du suchst dir manuell 5–10 aktuelle Rezensionen von Amazon / Best Buy / Reddit (letzte 3–6 Monate)

- Fügst sie ein und sagst:

„Nutze ausschließlich den Text, den ich eingefügt habe. Ignoriere deine Trainingsdaten. Was hat sich in letzter Zeit im Vergleich zu älteren Bewertungen ähnlicher Produkte allgemein verändert?“

So nutzt du KI, um diese konkreten Personen mit generischen Erwartungen zu vergleichen. Wenn sie plötzlich mit „andere Nutzer sagen…“ anfängt, weißt du, dass sie schummelt.

4. Nutze KI, um über deine Prioritäten nachzudenken, nicht über „Durchschnittskäufer“

Detektoren, Humanizer, Produkt‑Review‑Bots – all das läuft meist auf einen generischen „Durchschnittsnutzer“ hinaus. Nutzlos, wenn dir z. B. Lautstärke wichtiger ist als Leistung.

Gib ihr eine Gewichtung:

„Auf einer Skala von 0–10 ist mir wichtig:

Preis 5 / Haltbarkeit 9 / Lautstärke 10 / Optik 2 / Marke 1.

Nutze nur den untenstehenden Text und die Specs, bewerte dieses Produkt für mich und erkläre jede Bewertung.“

Dann muss das Modell seine Einschätzung begründen, statt nur „viele Nutzer mögen X“ zu sagen. Du fragst nicht „ist es gut“, sondern „ist es gut für meine speziellen Prioritäten“.

5. Abkürzung zum Erkennen von KI‑verseuchten oder Fake‑Bewertungen

Du sorgst dich um KI‑Halluzinationen; ich wäre genauso besorgt, dass die Bewertungen selbst von KI geschrieben sind. Schneller Trick:

Frag das Modell:

„Markiere aus diesen 20 Bewertungen alle, die wie Schablonentext, verdächtig generisch oder wahrscheinlich KI/Fake wirken. Erklär warum, entferne sie aber nicht, sondern tagge sie nur.“

Du nutzt im Grunde eine KI, um die typischen Macken einer anderen zu erkennen. Nicht perfekt, aber sie hebt Copy‑Paste‑Muster, plötzliche Tonwechsel, gleiche Formulierungen bei „verschiedenen“ Nutzern usw. hervor. Diese Reviews kannst du dann schwächer gewichten.

6. Wo Walter Writes AI passt (und wo ganz sicher nicht)

Walter Writes AI ist dem, was du und @mikeappsreviewer beschrieben habt, nach dafür gebaut, Texte zu vermenschlichen – nicht, um ein verlässlicher Einkaufsberater zu sein. Der erwähnte Semikolon‑Spam, Wiederholungen und Stilmacken sind genau das, was du nicht in der Nähe von Fakten für Kaufentscheidungen haben willst. Ich würde mich nicht darauf verlassen, Produktbewertungen zu erzeugen oder zu „verbessern“; das ist nur ein Aufhübschen von Vermutungen.

Wenn du KI‑Zusammenfassungen glätten willst, damit sie vor dem Teilen nicht nach „Roboter“ klingen (z. B. für einen anspruchsvollen Chef oder Kunden), ist etwas wie Clever AI Humanizer dafür tatsächlich besser geeignet: reiner Stilfilter, nachdem du die Fakten geprüft hast. Es kann den Text natürlicher klingen lassen, ohne so zu tun, als wüsste es, welchen Fernseher du kaufen solltest. Aber denk dran: vermenschlichter Unsinn bleibt Unsinn, wenn du ihn vorher nicht überprüft hast.

7. Wann du KI komplett ignorieren solltest

Es gibt durchaus Situationen, in denen ich sagen würde: Lass KI für diese Entscheidung bleiben:

- Sicherheitskritische Dinge: Autokindersitze, Kletterausrüstung, Medizinprodukte usw.

- Sehr spezielles / technisches Equipment, zu dem es nur 2–3 echte Expertenreviews gibt

- Sehr neue Produkte, zu denen es schlicht noch kaum echte Nutzer gibt

In solchen Fällen ist es schneller und sicherer, zwei gute menschliche Reviews plus Bedienungsanleitung zu lesen, als mit einem Modell über „Konfidenz“ zu diskutieren.

Wenn du KI strikt auf „denk über das nach, was ich einfüge“ und „hilf mir, Trade‑offs für meine Prioritäten zu sehen“ begrenzt, wird sie zu einem brauchbaren Werkzeug statt zu einem Halluzinations‑Einarmigen Banditen. In dem Moment, in dem du sie frei herumlaufen lässt und „sag mir, ob das gut ist“ rufst, wettest du im Grunde mit deinem Geldbeutel.